what & why

Compose 項目是 Docker 官方的開源項目,負責實現對 Docker 容器集群的快速編排。使用前面介紹的Dockerfile我們很容易定義一個單獨的應用容器。然而在日常開發工作中,經常會碰到需要多個容器相互配合來完成某項任務的情況。例如要實現一個 Web 項目,除了 Web 服務容器本身,往往還需要再加上後端的數據庫服務容器;再比如在分佈式應用一般包含若干個服務,每個服務一般都會部署多個實例。如果每個服務都要手動啟停,那麼效率之低、維護量之大可想而知。這時候就需要一個工具能夠管理一組相關聯的的應用容器,這就是Docker Compose。

Compose有2個重要的概念

- 項目(Project):由一組關聯的應用容器組成的一個完整業務單元,在 docker-compose.yml 文件中定義。

- 服務(Service):一個應用的容器,實際上可以包括若干運行相同鏡像的容器實例。

docker compose 安裝與卸載

安裝

二進制包在線安裝

curl -L https://github.com/docker/compose/releases/download/1.25.0/docker-compose-`uname -s`-`uname -m` -o /usr/local/bin/docker-compose

sudo chmod +x /usr/local/bin/docker-compose這個方法現在基本行不通,下載太慢了,不推薦使用。

二進制包離線安裝

從https://github.com/docker/compose/releases/download/1.25.0/docker-compose-Linux-x86_64下載對應的安裝包,比如我下載了Linux-x86_64的。

將下載好的安裝包剪切到/usr/local/bin/docker-compose目錄下

mv /app/download/docker-compose-Linux-x86_64 /usr/local/bin/docker-compose

添加執行權限

sudo chmod +x /usr/local/bin/docker-compose

pip安裝

- 先安裝好pip工具

#安裝依賴

yum -y install epel-release

#安裝PIP

yum -y install python-pip

#升級PIP

pip install --upgrade pip- 驗證pip 版本

[root@tymonitor bin]# pip --version

pip 8.1.2 from /usr/lib/python2.7/site-packages (python 2.7)-

安裝docker compose

pip install -U docker-compose==1.25.0 - 驗證docker compose版本

[root@tymonitor bin]# docker-compose --version

docker-compose version 1.25.0, build b42d419安裝補全插件

curl -L https://raw.githubusercontent.com/docker/compose/1.25.0/contrib/completion/bash/docker-compose > /etc/bash_completion.d/docker-compose

卸載

二進制卸載

rm /usr/local/bin/docker-compose

pip卸載

pip uninstall docker-compose

docker compose 重要命令

命令選項

- -f, –file FILE 指定使用的 Compose 模板文件,默認為 docker-compose.yml,可以多次指定。

- -p, –project-name NAME 指定項目名稱,默認將使用所在目錄名稱作為項目名。

- –x-networking 使用 Docker 的可拔插網絡後端特性

- –x-network-driver DRIVER 指定網絡後端的驅動,默認為 bridge

- –verbose 輸出更多調試信息。

- -v, –version 打印版本並退出。

常用&重要命令

-

config

驗證 Compose 文件格式是否正確,若正確則显示配置,若格式錯誤显示錯誤原因。

如:docker-compose -f skywalking.yml config

此命令不會執行真正的操作,而是显示 docker-compose 程序解析到的配置文件內容: -

images

列出 Compose 文件中包含的鏡像。如docker-compose -f skywalking.yml images -

ps

列出項目中目前的所有容器。如docker-compose -f skywalking.yml ps -

build

構建(重新構建)項目中的服務容器。如:docker-compose -f skywalking.yml build,一般搭配自定義鏡像,比如編寫的Dockfile,功能類似於docker build . -

up

該命令十分強大(重點掌握),它將嘗試自動完成包括構建鏡像,(重新)創建服務,啟動服務,並關聯服務相關容器的一系列操作。如docker-compose -f skywalking.yml up。默認情況,docker-compose up啟動的容器都在前台,控制台將會同時打印所有容器的輸出信息,可以很方便進行調試。如果使用

docker-compose up -d將會在後台啟動並運行所有的容器。一般推薦生產環境下使用該選項。

默認情況,如果服務容器已經存在,docker-compose up將會嘗試停止容器,然後重新創建(保持使用 volumes-from 掛載的卷),以保證新啟動的服務匹配docker-compose.yml文件的最新內容。如果用戶不希望容器被停止並重新創建,可以使用docker-compose up --no-recreate。這樣將只會啟動處於停止狀態的容器,而忽略已經運行的服務。如果用戶只想重新部署某個服務,可以使用docker-compose up --no-deps -d <SERVICE_NAME>來重新創建服務並後台停止舊服務,啟動新服務,並不會影響到其所依賴的服務。此命令有如下選項:

①:-d在後台運行服務容器。

②:--no-color不使用顏色來區分不同的服務的控制台輸出。

③:--no-deps不啟動服務所鏈接的容器。

④:--force-recreate強制重新創建容器,不能與 –no-recreate 同時使用。

⑤:--no-recreate如果容器已經存在了,則不重新創建,不能與 –force-recreate 同時使用。

⑥:--no-build不自動構建缺失的服務鏡像。

⑦:-t, --timeout TIMEOUT停止容器時候的超時(默認為 10 秒)。 -

down

此命令停止用up命令所啟動的容器並移除網絡,如docker-compose -f skywalking.yml down -

stop

格式為docker-compose stop [options] [SERVICE...]

停止已經處於運行狀態的容器,但不刪除它。通過docker-compose start可以再次啟動這些容器,如果不指定service則默認停止所有的容器。如docker-compose -f skywalking.yml stop elasticsearch

選項:

-t, --timeout TIMEOUT停止容器時候的超時(默認為 10 秒)。 -

start

啟動已經存在的服務容器。用法跟上面的stop剛好相反,如docker-compose -f skywalking.yml start elasticsearch -

restart

重啟項目中的服務。用法跟上面的stop,start一樣 -

logs

格式為docker-compose logs [options] [SERVICE...]

查看服務容器的輸出。默認情況下,docker-compose 將對不同的服務輸出使用不同的顏色來區分。可以通過 –no-color 來關閉顏色。該命令在調試問題的時候十分有用。如docker-compose -f skywalking.yml logs查看整體的日誌,docker-compose -f skywalking.yml logs elasticsearch查看單獨容器的日誌

docker compose 模板文件

模板文件是使用 Compose 的核心,涉及到的指令關鍵字也比較多。本文主要列出幾個常見&重要的指令,其他指令大家可以自行百度。

默認的模板文件名稱為 docker-compose.yml,格式為 YAML 格式。

version: '3'

services:

elasticsearch:

image: elasticsearch:6.8.5

container_name: elasticsearch

restart: always

volumes:

- /app/skywalking/elasticsearch/data:/usr/share/elasticsearch/data:rw

- /app/skywalking/elasticsearch/conf/elasticsearch.yml:/usr/share/elasticsearch/config/elasticsearch.yml

- /app/skywalking/elasticsearch/conf/jvm.options:/usr/share/elasticsearch/config/jvm.options

- /app/skywalking/elasticsearch/logs:/usr/share/elasticsearch/logs:rw

environment:

- TZ=Asia/Shanghai

- xpack.monitoring.enabled=false

- xpack.watcher.enabled=false

ports:

- "9200:9200"

- "9300:9300"注意每個服務都必須通過 image 指令指定鏡像或 build 指令(需要 Dockerfile)等來自動構建生成鏡像。如果使用 build 指令,在 Dockerfile 中設置的選項(例如:CMD, EXPOSE, VOLUME, ENV 等) 將會自動被獲取,無需在 docker-compose.yml 中重複設置。

常用&重要命令

images

指定為鏡像名稱或鏡像 ID。如果鏡像在本地不存在,Compose 將會嘗試拉取這個鏡像。

image: apache/skywalking-oap-server:6.5.0

image: apache/skywalking-ui:6.5.0ports

暴露端口信息。

使用宿主端口:容器端口 (HOST:CONTAINER) 格式,或者僅僅指定容器的端口(宿主將會隨機選擇端口)都可以,端口字符串都使用引號包括起來的字符串格式。

ports:

- "3000"

- "8080:8080"

- "127.0.0.1:8001:8001"volumes

數據卷所掛載路徑設置。可以設置為宿主機路徑(HOST:CONTAINER)或者數據卷名稱(VOLUME:CONTAINER),並且可以設置訪問模式 (HOST:CONTAINER:ro)。

volumes:

- /app/skywalking/elasticsearch/data:/usr/share/elasticsearch/data:rw

- conf/elasticsearch.yml:/usr/share/elasticsearch/config/elasticsearch.ymlversion: "3"

services:

my_src:

image: mysql:8.0

volumes:

- mysql_data:/var/lib/mysql

volumes:

mysql_data:ulimits

指定容器的 ulimits 限制值。

例如,指定最大進程數為 65535,指定文件句柄數為 20000(軟限制,應用可以隨時修改,不能超過硬限制) 和 40000(系統硬限制,只能 root 用戶提高)。

ulimits:

nproc: 65535

nofile:

soft: 20000

hard: 40000depends_on

解決容器的依賴、啟動先後的問題。以下例子中會先啟動 redis mysql 再啟動 web

version: '3'

services:

web:

build: .

depends_on:

- db

- redis

redis:

image: redis

db:

image: mysqlenvironment

設置環境變量。你可以使用數組或字典兩種格式。

environment:

SW_STORAGE: elasticsearch

SW_STORAGE_ES_CLUSTER_NODES: elasticsearch:9200

environment:

- SW_STORAGE= elasticsearch

- SW_STORAGE_ES_CLUSTER_NODES=elasticsearch:9200restart

指定容器退出后的重啟策略為始終重啟。該命令對保持服務始終運行十分有效,在生產環境中推薦配置為always或者unless-stopped。

restart: always

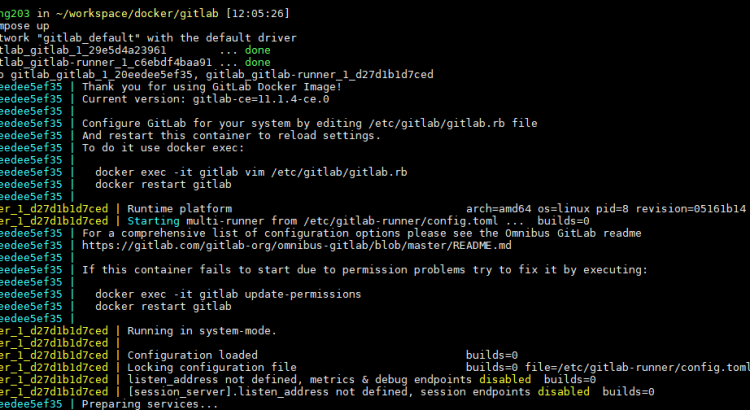

docker-compose 實戰

首先我需要推薦兩件事:

- 配置docker加速鏡像

創建或修改/etc/docker/daemon.json

sudo mkdir -p /etc/docker

sudo tee /etc/docker/daemon.json <<-'EOF'

{

"registry-mirrors": [

"https://hub-mirror.c.163.com",

"https://mirror.ccs.tencentyun.com",

"https://reg-mirror.qiniu.co"

]

}

EOF

sudo systemctl daemon-reload

sudo systemctl restart docker- 給你的ide工具裝上docker插件

本次實戰我們以docker-compose部署skywalking為例。編寫skywalking.yml,內容如下。

version: '3.3'

services:

elasticsearch:

image: docker.elastic.co/elasticsearch/elasticsearch:6.8.5

container_name: elasticsearch

restart: always

ports:

- 9200:9200

- 9300:9300

environment:

discovery.type: single-node

ulimits:

memlock:

soft: -1

hard: -1

oap:

image: skywalking/oap

container_name: oap

depends_on:

- elasticsearch

links:

- elasticsearch

restart: always

ports:

- 11800:11800

- 12800:12800

environment:

SW_STORAGE: elasticsearch

SW_STORAGE_ES_CLUSTER_NODES: elasticsearch:9200

ui:

image: skywalking/ui

container_name: ui

depends_on:

- oap

links:

- oap

restart: always

ports:

- 8080:8080

environment:

SW_OAP_ADDRESS: oap:12800部署完成后將其上傳至服務器,執行docker-compose -f /app/skywalking.yml up -d即可。

個人公眾號:JAVA日知錄 ,

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理【其他文章推薦】

※USB CONNECTOR 掌控什麼技術要點? 帶您認識其相關發展及效能

※高價3c回收,收購空拍機,收購鏡頭,收購 MACBOOK-更多收購平台討論專區

※評比前十大台北網頁設計、台北網站設計公司知名案例作品心得分享

※收購3c瘋!各款手機、筆電、相機、平板,歡迎來詢價!

※智慧手機時代的來臨,RWD網頁設計已成為網頁設計推薦首選